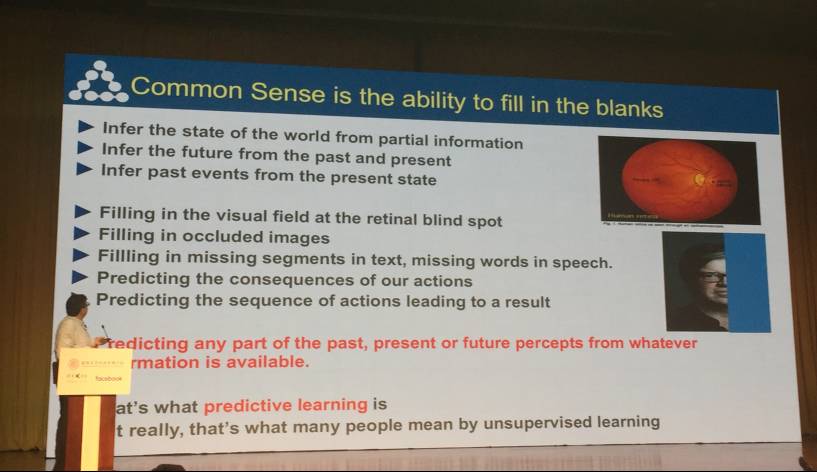

机器是无法凭空具备常识的,它需要一些已知的信息,比如根据空间信息推断世界的状态、从过去和现在推断未来、从现在的状态推断过去的事件。那么,这个过程就涉及预测学习(predictive learning)这一个概念,也就是从提供的任何信息预测过去、现在以及未来的任何一部分。不过,这是很多人对无监督学习(unsupervised learning)的定义。

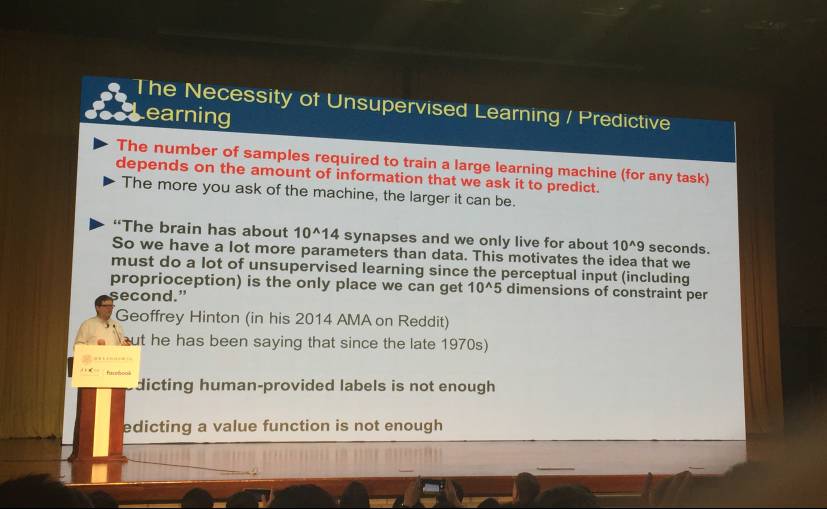

由此看见,无监督学习和预测学习是十分必要的,也是未来几年深度学习型领域的巨大挑战。通常,需要拿来去训练一个大型学习机器的样本数量取决于我们要求机器所预测的信息量。你需要机器回答的问题越多,样本数量就要越大。

「大脑有 10 的 14 次方个突触,我们却只能活大概 10 的 9 次方秒。因此我们的参数比我们所获得的数据会多得多。这一事实激发了这一思想:既然感知输入(包括生理上的本体感受)是我们每秒获取 10^5 维度约束(10^5 dimensions of constraint)的唯一地方,那么,就必须进行大量的无监督学习。」

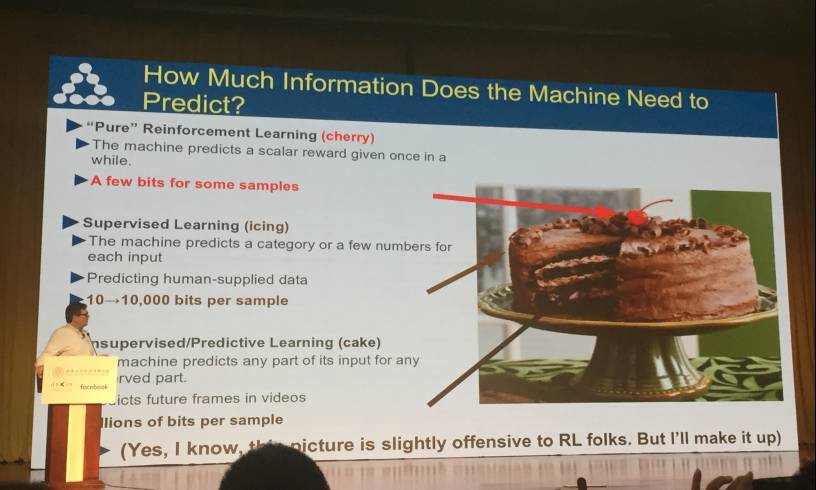

预测人类提供的标签,一个价值函数(value function)是不够的。这里,Yann LeCun 用一个生动的比喻解释了不同机器学习算法进行预测需要多少信息,并展示了 2016 年 VizDoom 竞赛冠军使用的来自强化学习的 Actor-Critic 算法来生成序列的实例。

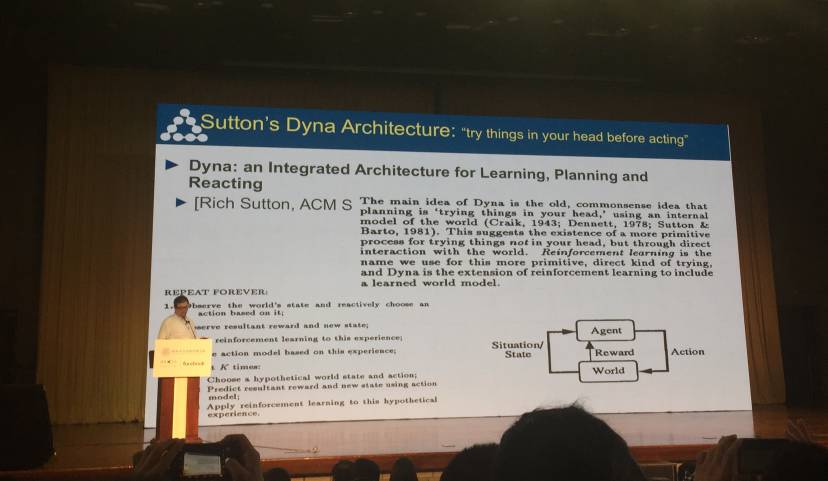

此处,Yann LeCun 提到了 Sutton 所提出的 Dyna 结构,这是一种集学习、规划、反应于一身的集成架构,即可以完成「在行动之前实现对脑内设想的尝试」。

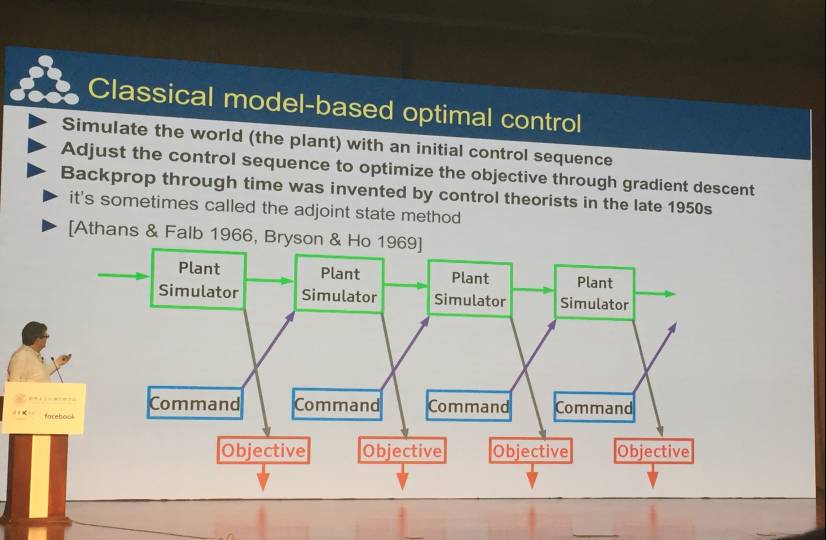

之后,Yann LeCun 介绍了经典基于模型的最优化控制过程。即利用初始控制序列对世界进行仿真,调整控制序列利用梯度下降法对目标进行最优化,再进行反向传播。

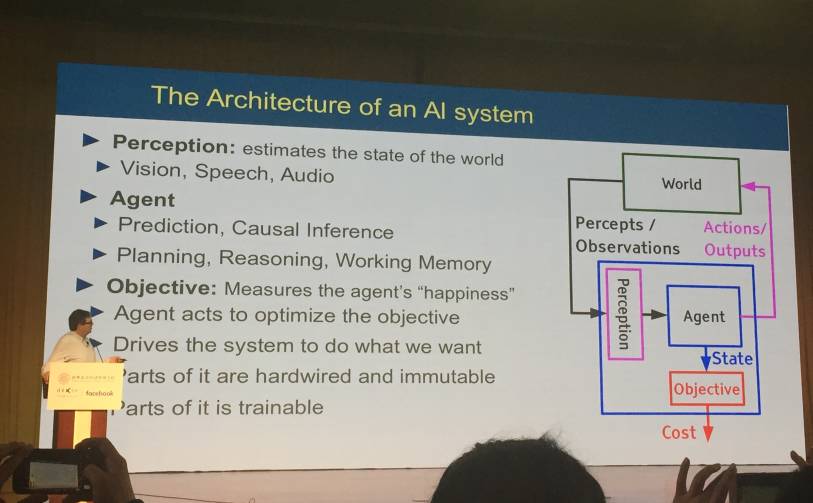

人工智能系统的架构,包括感知器、代理、目标、环境。

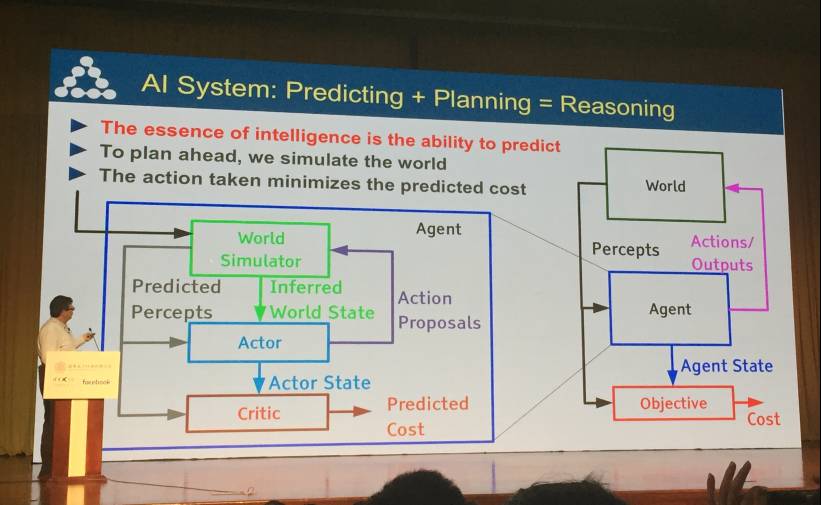

用一个公式概括了人工智能系统,即:预测+规划=推理。

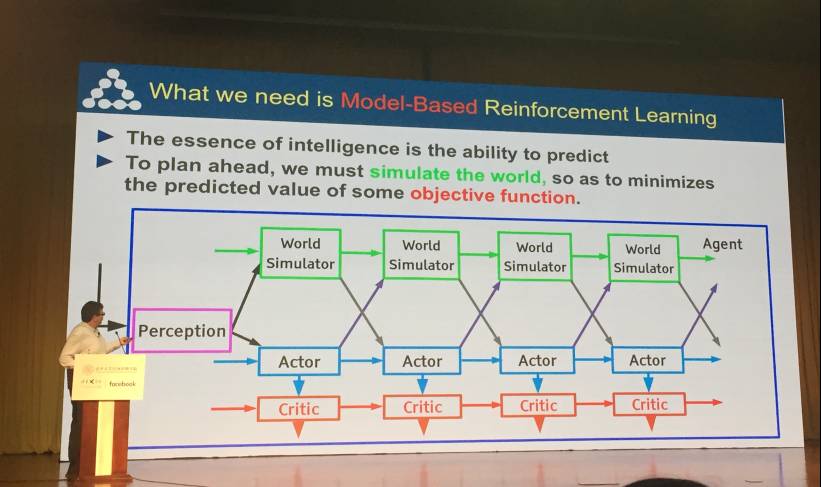

智能的本质是预测的能力,要提前进行规划,我们需要模拟这个世界,然后采取行动以最小化预测损失。

最终得出结论:基于模型的强化学习正是我们需要的。

Yann LeCun 指出,机器能否学习出预测世界的模型是实现重大进展的关键。

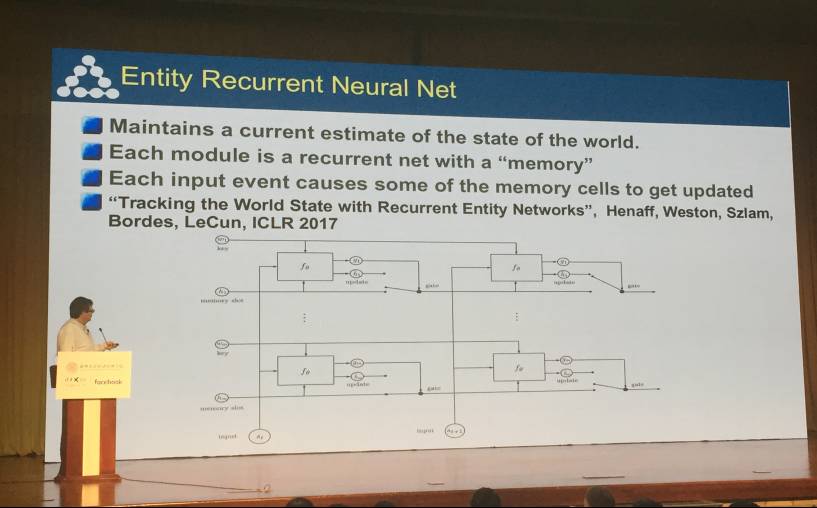

然后,他也介绍了「根据文本推断世界的状态:实体 RNN」

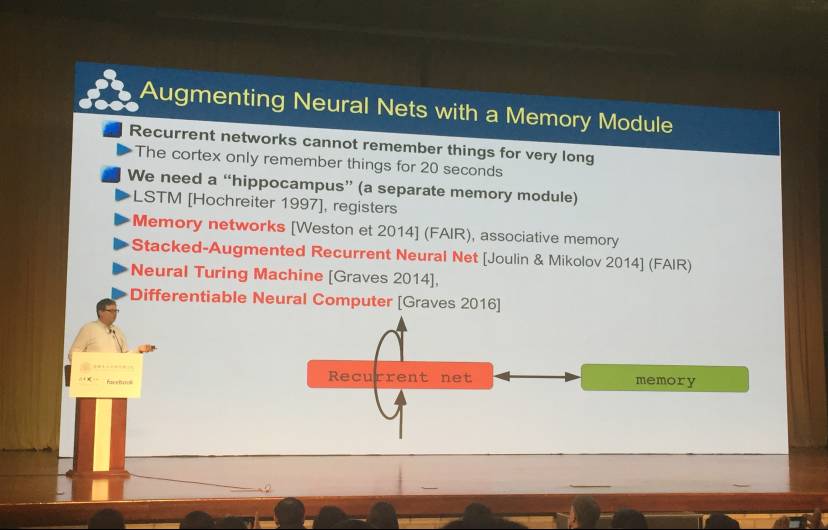

尽管监督式卷积网络已经取得了重大的进展,我们仍需要记忆增强网络赋予机器进行推论的能力。LeCun 帮助我们理解记忆了堆栈增强循环神经网络。

使用记忆模块增强神经网络

循环网络不能进行长期记忆

皮层记忆只能持续 20 秒

神经网络需要一个「海马体」(一个单独的记忆模块)

长短期记忆(LSTM)[Hochreiter 1997],寄存器

记忆网络 [Weston et 2014] (FAIR),联合存储器

堆栈增强循环神经网络 [Joulin & Mikolov 2014] (FAIR)

神经图灵机 [Graves 2014]

可微分神经计算机 [Graves 2016]

实体循环神经网络

维持一个对于当前世界状态的估计

每一个网络都是一个带有一个记忆的循环网络

每一个输入事件都会导致记忆单元获得一些更新

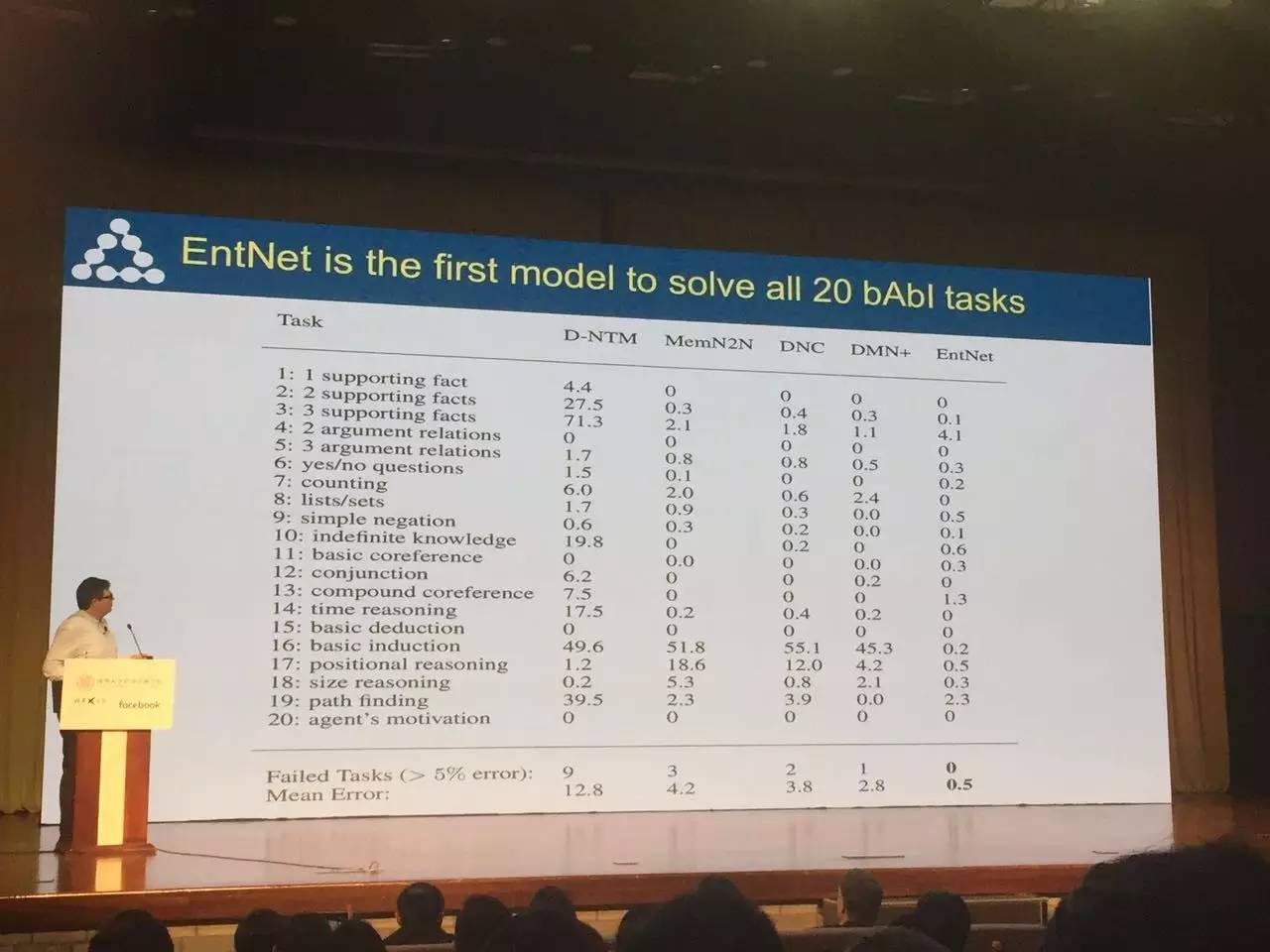

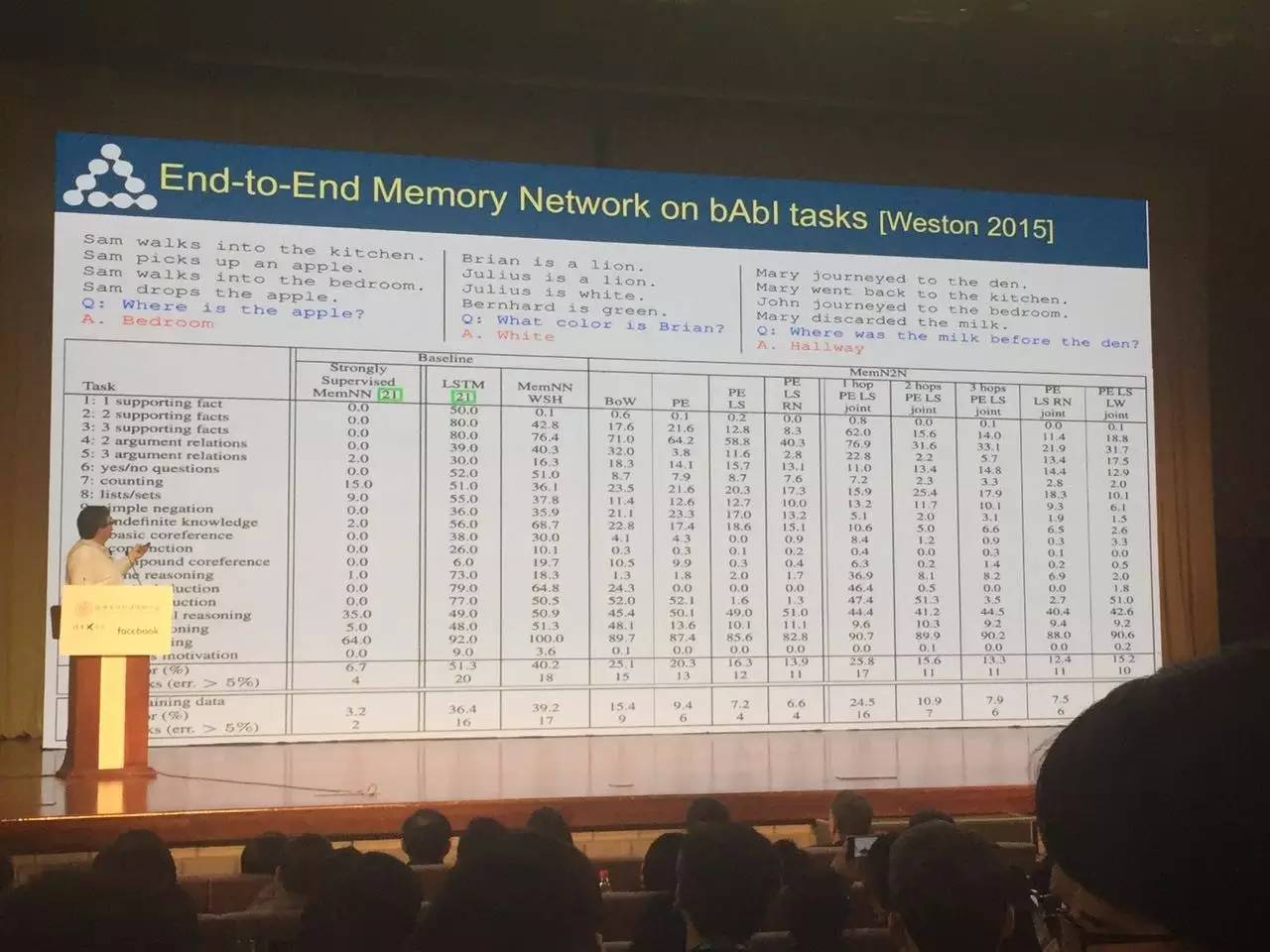

EntNet 是第一种解决了所有 20 中 bAbI 任务的模型

在 bAbI 任务上的端到端记忆网路

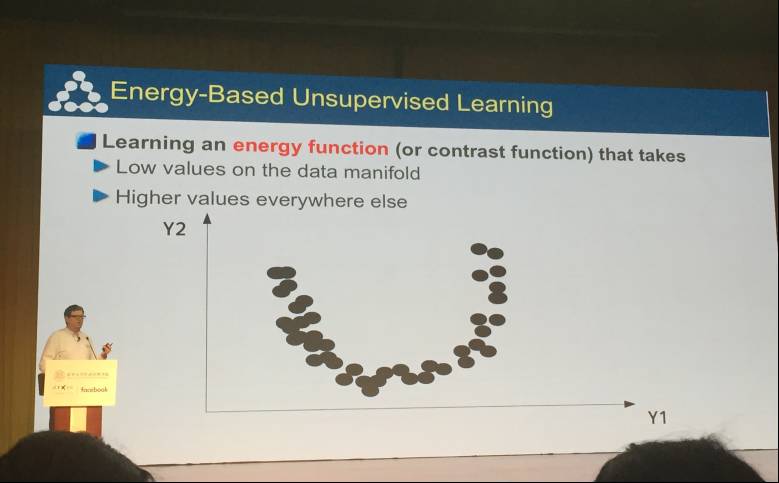

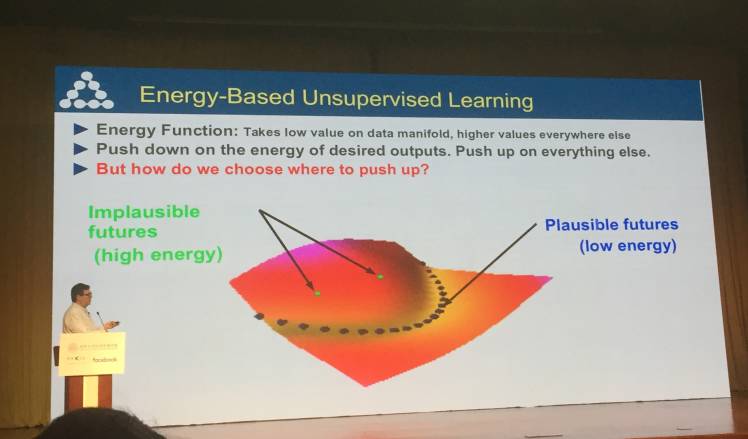

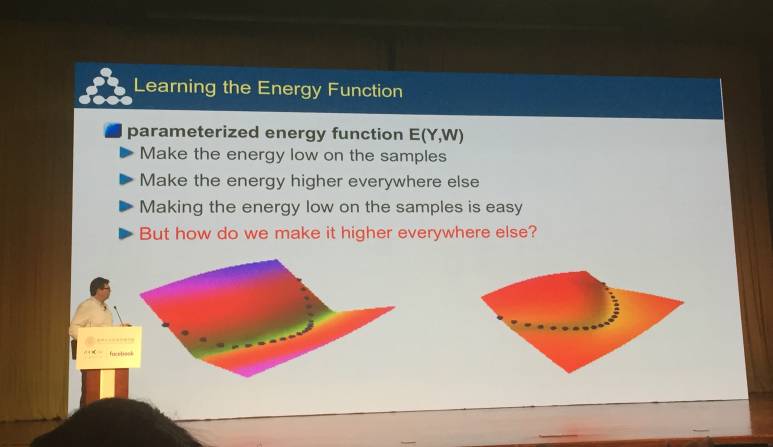

在这一部分,Yann LeCun 对基于能量的无监督学习算法进行了比较详细的解析。

学习一个能量函数(或称对比函数),其在数据流形上取低值,在其它地方去高值。

压低我们想要的输出的能量,推高其它地方。但我们该怎么选择推高哪里呢?

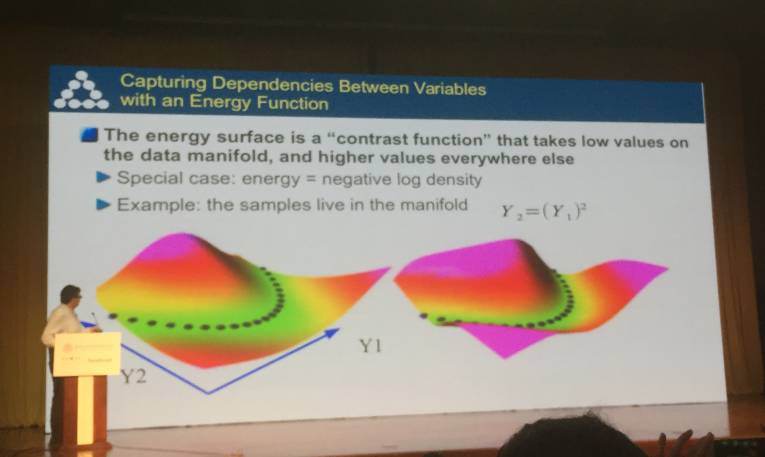

使用一个能量函数来获取变量之间的依赖

学习能量函数

参数化能量函数:E(Y,W)

使其在样本上的能量低

使其在其它地方的能量高

是能量在样本上低很容易,但要让其它地方它高起来该怎么做呢?

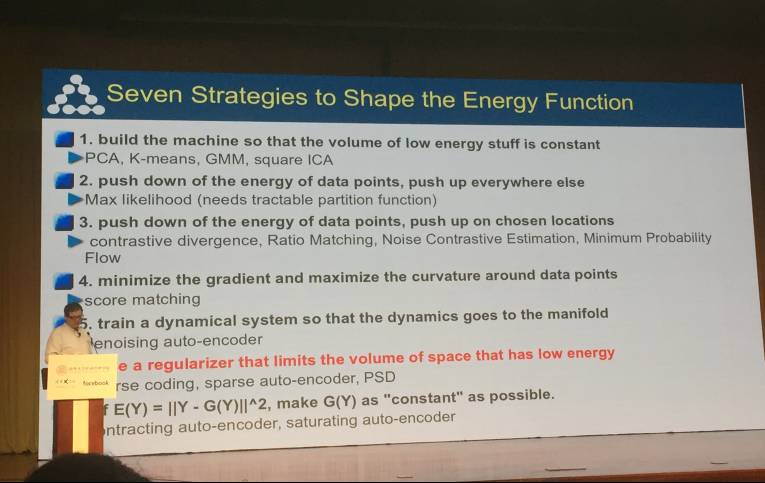

塑造能量函数的 7 种策略

1. 建立低能量体量(the volume of low energy stuff)不变的机器

PCA、K-means、GMM、square ICA

2. 数据点能量的下推(push down),其他位置能量都提高(push up)

最大似然(需要易操作的配分函数)

3. 数据点能量的下推(push down),在选择出的点上进行提高

contrastive divergence、Ratio Matching、Noise Contrastive Estimation、Minimum Probability Flow

4. 围绕数据点最小化梯度,最大化曲率(curvature)

score matching

5. 训练一个动态系统,以便于动态进入 manifold

降噪自编码器

6. 使用正则化进行限制有低能量的空间体量

Sparse coding、sparse auto-encoder、PSD

7. 如果 E(Y) = ||Y - G(Y)||^2, 尽可能的使得 G(Y) 不变

Contracting auto-encoder, saturating auto-encoder

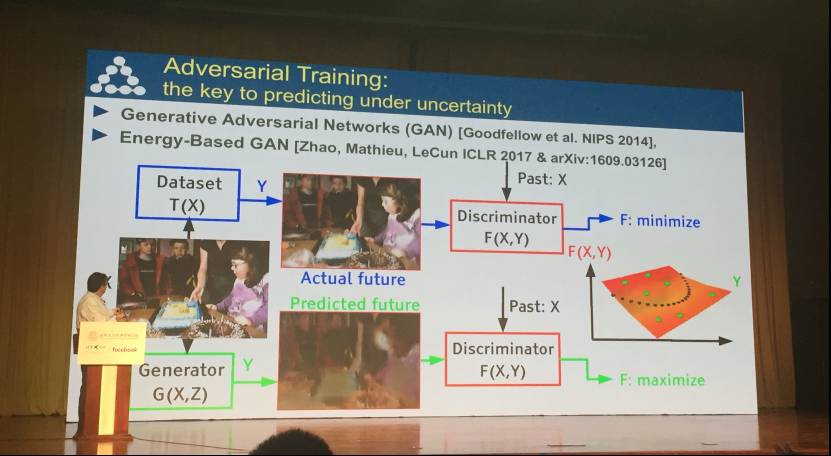

接下来,是关于对抗训练的介绍,Yann LeCun 本人对对抗训练给予高度肯定。对抗训练(GAN)是改进机器预测能力的一种方式。GAN 包括一个生成器、一个判别器,它们可以同时进行学习。

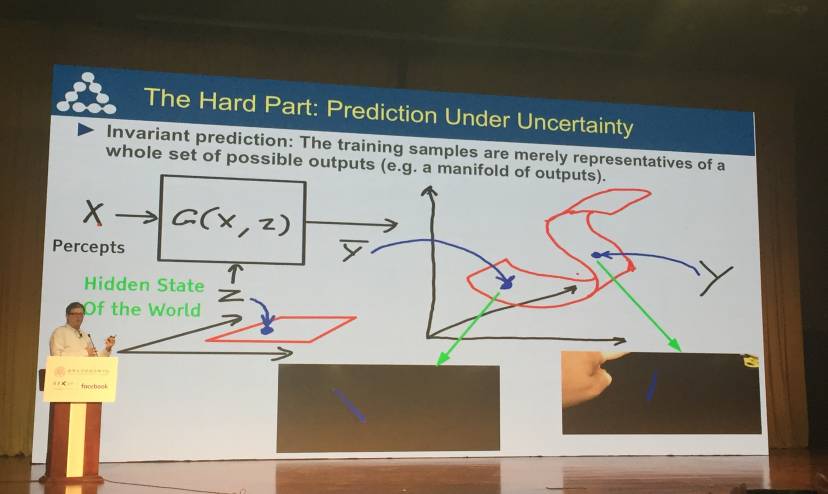

它的难点在于在不确定性下进行预测。

不变的预测:训练样本只是整个可能输出集的表示

对抗训练:不确定情况下进行预测的关键

除了深度卷积对抗生成网络 (DCGAN),他还介绍了基于能量的对抗生成网络(EBGAN)。(详情可见:))

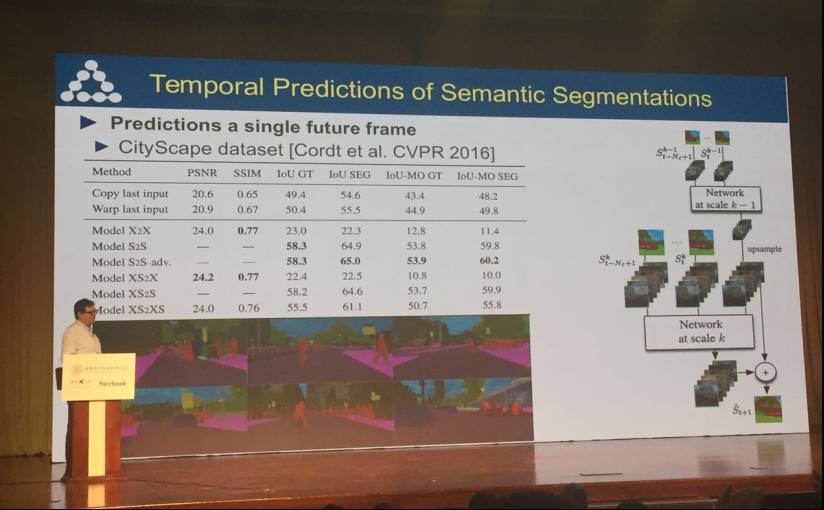

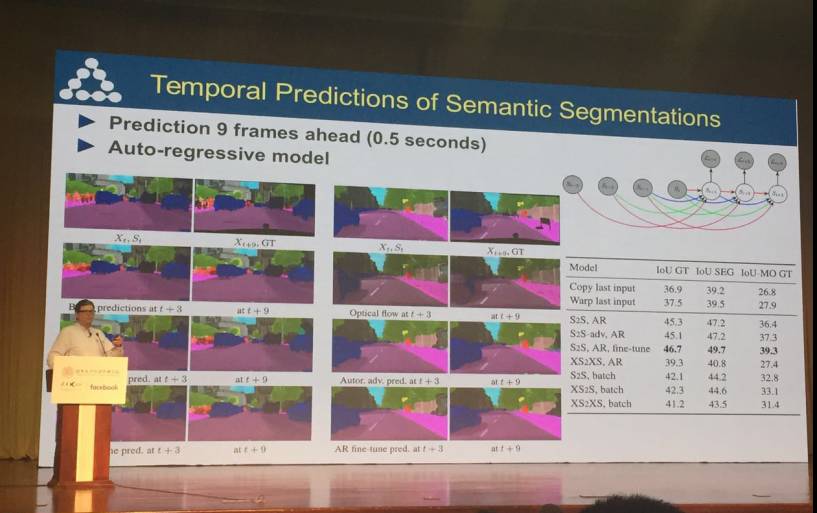

在演讲的最后,Yann LeCun 提到了语义分割的视频预测技术,并展示了时间预测结果。

语义分割的时间预测

语音分割的暂时性预测:提前 9 帧(0.5 秒)进行预测;自回归模型;

转载请注明出处。

相关文章

相关文章 精彩导读

精彩导读 热门资讯

热门资讯 关注我们

关注我们